A AMEAÇA NUCLEAR, AS APLICAÇÕES DA INTELIGÊNCIA ARTIFICIAL E AS PERSPECTIVAS DE LONGO PRAZO PARA A VIDA NA TERRA

INTRODUÇÃO

As sociedades enfrentam, actualmente, um conjunto de ameaças graves que põem em causa a existência de vida sobre o planeta Terra. Essas ameaças são, como sabemos, de diferente natureza. As mais graves não se devem a fenómenos naturais: resultam da aplicação deliberada de avanços tecnológicos em benefício de poucos, que servem os interesses de certas empresas ou constelações de empresas poderosas. Uma dessas constelações é o chamado complexo militar-industrial.

Nesse contexto, é pertinente citar o Dr. John Chipman, Director-Geral e Executivo do International Institute for Strategic Studies em Londres, por ocasião da divulgação do relatório “The Military Balance 2016”[i]: “Está a crescer o acesso a tecnologias de ponta com potenciais aplicações militares. Esta equalização das condições de acesso a tais tecnologias coloca os governos perante o desafio, não apenas de se manterem a par dos desenvolvimentos tecnológicos mais recentes e monitorizarem a sua proliferação, mas também de lidarem com as fronteiras que se esbatem entre tecnologias civis e militares e sistemas militares ofensivos e defensivos”. “O pressuposto da superioridade tecnológica e militar do Ocidente, que foi um pressuposto essencial nas passadas duas décadas, está posto em causa”, acrescentou o Dr. Chipman. Os seus comentários continuavam válidos quando foi publicada a edição seguinte do Relatório, a 14 de Fevereiro de 2017. Quanto ao equilíbrio do poder militar, vale a pena referir aquilo que Paul Craig Roberts, um distinto economista, presidente do Institute for Political Economy, antigo editor do Wall Street Journal e Secretário Adjunto do Tesouro dos EUA sob o Presidente Ronald Reagan, afirmou recentemente: “o poderio militar dos EUA é agora de segunda ordem, quando comparado com os dos Russos”[ii].

A iliteracia, entendida como condição ou qualidade de ser ignorante ou desconhecedor sobre determinado assunto, pode representar uma grave desvantagem. Quando a pessoa ou pessoas iletradas são governantes ou decisores políticos, a sua iliteracia social, cultural e científica pode transformar-se numa ameaça para a sociedade. A negação das alterações climáticas ou da teoria darwinista da evolução são casos particulares de negação da ciência, tal como é a convicção de que uma guerra nuclear pode ser ganha. Isto nada tem que ver com a ciência em si mesma, evidentemente, mas chama a atenção para a necessidade de se investir fortemente numa cruzada de consciencialização contra ideias erróneas alojadas no espírito de grande número dos nossos concidadãos.

Trata-se, escusado será dizê-lo, de uma tarefa considerável e que não será bem sucedida se não houver um envolvimento sério dos trabalhadores científicos socialmente responsáveis.

_________________________________

Este ano celebra-se o 70º aniversário do Doomsday Clock (diversamente traduzido como Relógio do Fim do Mundo, do Apocalipse ou do Juízo Final), uma imagem gráfica que foi publicada na capa da primeira edição do Bulletin of theAtomic Scientists. Desde então, o Doomsday Clock, como é geralmente conhecido, tem servido de bitola gobal para aferir da saúde e segurança do planeta. A 26 de Janeiro deste ano, os ponteiros do Relógio avançaram e estão agora 30 segundos mais próximos da meia-noite. Os ponteiros do relógio marcavam 3 minutos para a meia-noite desde Janeiro de 2015.[iii] A posição dos ponteiros reflecte a avaliação que é feita das actuais ameaças que armas nucleares e alterações climáticas colocam à existência da humanidade, tomando também em consideração as ameaças potenciais que derivam do aparecimento de novas tecnologias, entre as quais os sistemas de armas letais autónomas, capazes de tomar decisões de “matar” sem interferência ou supervisão humanas, representam uma ameaça particularmente grave.

Após uma breve síntese sobre a despesa mundial com a defesa, este artigo analisa os mais recentes desenvolvimentos tecnológicos bem como as políticas e pensamento estratégico associados às Armas Nucleares. Os capítulos seguintes são dedicados às potencialidades e ameaças ds aplicações da Inteligência Artificial e Robótica, com uma ênfase especial nas armas e sistemas de armamentos autónomos.

DESPESAS COM A DEFESA

Segundo o SIPRI, o Stockholm International Peace Research Institute, as despesas militares no mundo aumentaram para $1686 mil milhões [iv] em 2016 (a preços constantes de 2015, em US$). Desde 2000, as despesas militares mundiais aumentaram 60%. Os dados do SIPRI mostram que, em 2016, as despesas aumentaram nos EUA e na Europa (sobretudo na Europa Oriental) e diminuíram nos países exportadores de petróleo, em particular na Arábia Saudita. De acordo com os dados mais recentes publicados pelo SIPRI[v], os Estados Unidos continuam a ser o país do mundo com a maior despesa militar anual. A República Popular da China vem em segundo lugar, com um terço das despesas norte-americanas. Segue-se em terceiro lugar a Federação Russa, que em 2015 ocupava a quarta posição atrás da Arábia Saudita. As suas posições inverteram-se entretanto. As despesas militares da Rússia e Arábia Saudita estão muito próximas, correspondendo a $69 e $64 mil milhões, respectivamente. A quinta maior despesa militar do mundo é a da Índia, com $56 mil milhões.

Não existe uniformidade nos critérios usados para avaliar as despesas militares.

Num artigo recente, Kimberly Amadeo, especialista em análise económica e estratégias empresariais, estimava que o orçamento militar dos EUA para o ano fiscal de 2018 será de $824.6 mil milhões. Este valor inclui o orçamento de base solicitado para o Departamento da Defesa, mas não outros itens. Nas palavras de Amadeo, “ironicamente, o orçamento de base do DoD não inclui o custo das guerras”. Essas despesas cabem na rubrica Overseas Contingency Operations(Operações de Contingência no Exterior), orçamentadas em US$77 mil milhões[vi]. No valor acima referido também não estão incluídos outros itens.

Vale a pena acrescentar que, segundo diversas fontes, o Departamento de Defesa dos EUA continua a ser

o único departamento federal não auditado. Como refere o jornal britânico The Guardian, “embora tal seja exigido por lei, o DoD nunca foi sujeito a uma auditoria, (…) algo a que qualquer empresa ou outro departamento governamental estão obrigados. O resultado é a existência de uma verba impressionante de $10 milhões de milhões de dinheiro dos contribuintes acerca da qual nunca foram prestadas contas desde 1996”[vii]

A AMEAÇA NUCLEAR

A guerra nuclear é, possivelmente, a mais grave das diversas ameaças que pairam actualmente sobre o mundo.

Em meados de 2017, existiam cerca de 10000 armas nucleares em arsenais militares. Destas, aproximadamente 4000 estão operacionalmente disponíveis, cerca de 2000 estão em alerta elevado e prontas para serem usadas a curto prazo. O rendimento total ou poder explosivo das armas nesta última categoria corresponde a cerca de mil MT de TNT equivalente.[viii] A Federação Russa e os Estados Unidos da América possuem cerca de 90% do inventário global destas armas.[ix]

O Artigo VI do Tratado sobre a Não-proliferação de Armas Nucleares, que ambos os estados ratificaram, representa, até à data ,o único compromisso vinculativo de desarmamento por estados que possuem armas nucleares num tratado multilateral.[x] É evidente que nenhum dos estados signatários tomou quaisquer medidas nesse sentido. No caso dos EUA, foi lançado e está em curso um ambicioso programa de modernização das forças nucleares do país. O programa inclui, para além dos explosivos nucleares per se, as diversas componentes da chamada “tríade nuclear”, ou seja, as três componentes de um arsenal nuclear estratégico que permitem lançar ogivas nucleares contra alvos escolhidos. As componentes da “tríade” são os mísseis balísticos intercontinentais lançados a partir de terra (intercontinental ballistic missiles, ICBMs), os bombardeiros estratégicos, e os mísseis balísticos lançados a partir de submarinos (submarine-launched ballistic missiles, SLBMs). O programa de modernização foi posto em marcha por Barak Obama há alguns anos, após o seu famoso discurso de Praga em Abril de 2009.[xi] Nessa altura, ele afirmou: “(…) enquanto potência nuclear – a única potência nuclear a ter alguma vez usado uma arma nuclear – os Estados Unidos têm a responsabilidade moral de agir“, sublinhando “(…) ocompromisso da América em procurar a paz e segurança num mundo sem armas nucleares”. E declarou também que “(…) os Estados Unidos darão passos concretos para construir um mundo sem armas nucleares”.

Na verdade, foi o Presidente Barack Obama, laureado com o Prémio Nobel da Paz em 2009, quem pôs em marcha planos para uma reconstituição maciça e dispendiosa do arsenal norte-americano. Segundo uma análise à informação orçamental do Governo dos EUA realizada pela Arms Control Association,[xii] o custo total das forças nucleares desde o ano fiscal 2018 e até 2047 está estimado entre $1,25 e $1,46 milhões de milhões a preços correntes (os aumentos dos preços devidos à inflação estimada ao longo do período de 30 anos foram incluídos). Crê-se que muito desse esforço ainda está no seu início e levará, na verdade, décadas a concluir, se não ocorrerem alterações significativas no cenário geo-político, desejavelmente a favor da paz. Em Agosto deste ano, o Presidente Trump reiterou o seu compromisso com a prossecução da política definida pelo seu antecessor, afirmando numa conferência de imprensa que a sua “primeira ordem enquanto Presidente foi para renovar e modernizar o nosso arsenal nuclear”. Nessa ocasião, acrescentou que esse arsenal “(…) é agora mais forte e mais poderoso do que nunca”, uma afirmação que parece ter pouca sustentação na realidade.

Um míssil balístico Trident lançado por um submarino emergindo do mar

Trump herdou o “programa de modernização nuclear” e “(…) propõe-se avançar a todo o vapor com a abordagem de Obama. Tal não surpreende, tendo em conta que a (actual) administração ainda tem de deixar a sua própria marca na política nuclear dos EUA[xiii].

O “programa de revitalização atómica” tem sido apresentado ao público como um esforço para garantir a fiabilidade e segurança das ogivas do arsenal nuclear norte-americano e não como um esforço para reforçar a sua capacidade militar. Na verdade, o programa deu origem ao desenvolvimento e ensaio de bombas atómicas “mais inteligentes, de grande precisão, mais pequenas e furtivas, reduzindo desse modo perigosamente o chamado “limiar nuclear”, ou seja, as circunstâncias em que alguns poderão considerar “aceitável” usar armas nucleares num possível campo de batalha ou mesmo contra alvos não-militares. Esta abordagem de “construir mais pequeno” é do agrado dos altos círculos políticos e militares nos EUA, onde se “pensa no impensável”. A ideia de um ataque nuclear preventivo contra uma hipotética potência inimiga está associada à crença de que uma guerra nuclear pode ser ganha.

Em resultado do trabalho realizado no quadro do programa referido, a capacidade do arsenal de mísseis balísticos norte-americanos para atingirem os seus alvos e, em consequência, o seu poder mortífero, aumentaram cerca de três vezes, criando “exactamente aquilo que seria expectável se um estado com armas nucleares estivesse a planear adquirir a capacidade para se envolver e vencer uma guerra nuclear, desarmando os seus inimigos ao atacar primeiro de surpresa.”[xiv]

O DESENVOLVIMENTO DA INTELIGÊNCIA ARTIFICIAL

PROMESSAS E AMEAÇAS

As guerras contra supostos inimigos assumem nos nossos dias uma diversidade de formas, a maioria das quais estão para lá da compreensão do homem ou mulher comuns. Por isso, as suas consequências, tanto no curto como no longo prazo, são pouco ou nada conhecidas.

As armas autónomas, muitas vezes designadas de robôs-assassinos, são um componente importante das novas armas tecnologicamente avançadas. Não estão incluídas na Convenção das Nações Unidas sobre Certas Armas Convencionais (United Nations Convention on Certain Conventional Weapons, CCWC). Actualmente, são 124 os Estados Partes na Convenção, que entrou em vigor em Dezembro de 1983 e visa a “proibição ou limitação do uso de certas armas convencionais que podem ser consideradas como produzindo efeitos traumáticos excessivos ou ferindo indiscriminadamente”[xv]. As armas abrangidas pela convenção são as minas, armadilhas, armas incendiárias e armas laser que provocam cegueira.

A Convenção também consagra a responsabilidade das partes contratantes que utilizaram armas explosivas num conflito, no auxílio à desminagem e neutralização das minas e armadilhas instaladas após o seu termo.

Em anos recentes, diversos organismos e especialistas têm levantado a questão da proibição do uso de robôs para fins militares, sendo que as armas autónomas representam a principal preocupação. Na Quinta Conferência de Revisão da Convenção sobre Armas Convencionais, que se realizou em Genebra em Dezembro de 2016, os representantes de 123 Estados Partes na Convenção acordaram unanimemente iniciar discussões formais sobre armas autónomas. Desses, 19 Estados Partes apelaram a uma proibição expressa desse tipo de armas.

A Conferência decidiu criar um Grupo aberto de Peritos Governamentais (Group of Governmental Experts, GGE) sobre tecnologias emergentes e sistemas autónomos de armas letais (lethal autonomous weapons systems, LAWS) em 2017. A primeira sessão de trabalho do grupo devia ter-se realizado em 21 de Agosto, mas foi adiada para Novembro.[xvi] É importante referir que as reuniões do Grupo estão abertas a todas as Altas Partes Contratantes e a partes não-estatais, organizações internacionais e organizações não-governamentais.

Em Agosto do ano passado, líderes de empresas de inteligência artificia (IA) e robótica de todo o mundo divulgaram uma carta aberta, onde apelam às Nações Unidas para que proíbam as armas autónomas. A carta, divulgada pelo “The Future of Life Institute”,[xvii] foi endereçada aos representantes dos 124 Estados Partes na Convenção sobre Armas Convencionais na véspera da reunião das partes, marcada para 21 de Agosto de 2017.

Foi a primeira vez que as empresas de IA e robótica tomaram uma posição conjunta sobre a matéria. A carta, assinada por 116 fundadores de empresas de robótica e inteligência artificial de 26 países, insta as Nações Unidas a lidarem urgentemente com o desafio que representam as armas autónomas letais e a proibirem internacionalmente o seu uso.

Segundo os signatários (citação) “as armas autónomas letais ameaçam transformar-se na terceira revolução nas tecnologias da guerra (…). Uma vez desenvolvidas, permitirão que os conflitos armados se desenrolem a uma escala nunca vista e a um ritmo que ultrapassa a compreensão humana”. Acrescentando (citação) “não nos resta muito tempo para agir. Uma vez aberta, essa caixa de Pandora será difícil de fechar”, justificando desse modo o seu apelo urgente às Nações Unidas.

Além disso, há cerca de dois anos, na IJCAI 2015[xviii], mais de 1000 investigadores em IA tinham publicado uma carta aberta onde pediam uma proibição das armas autónomas letais. Até à data, essa carta aberta foi assinada por 3462 investigadores em IA/Robótica e por 18 909 outros.[xix]

É importante caracterizar brevemente aquilo que se entende normalmente porInteligência Artificial. Uma possível definição é a seguinte: “a capacidade de um computador digital ou robô controlado por computador, de desempenhar tarefas comummente associadas a seres inteligentes”. A expressão é frequentemente aplicada a projectos que têm como objectivo desenvolver sistemas dotados dos processos intelectuais que são característicos dos seres humanos, tais como a capacidade de raciocinar, descobrir sentido, fazer generalizações ou aprender com experiências passadas[xx]. Os algoritmos de auto-aprendizagem constituem uma pedra angular da IA.

Tal como sucede com outros avanços tecnológicos, é necessário estarmos atentos às aplicações que são contrárias aos interesses da sociedade e, principalmente, da paz mundial e direitos humanos.

É por demais evidente que a IA e domínios associados da ciência e tecnologia continuarão a desenvolver-se rapidamente. Não devemos subestimar as motivações por detrás de uma afirmação como “o futuro é agora” que se ouve em diferentes quadrantes. Os trabalhadores científicos socialmente responsáveis têm a obrigação de se manter alerta e preparados para actuar a bem da sociedade, usando os meios ao seu alcance.

Nalguns círculos políticos, a consciência daquilo que está em jogo tem-se manifestado em diferentes ocasiões. Noutros, parece reinar a ignorância pura e simples.

Existem, contudo, diferenças consideráveis de pontos de vista entre as elites conhecedoras, seja na esfera política ou na própria comunidade de IA, relativamente ao impacto que a disseminação de aplicações envolvendo IA poderá ter sobre as sociedades humanas.

O estado de coisas acima referido é particularmente bem ilustrado pela notícia difundida pelos media segundo a qual no dia 1 de Setembro do ano passado – um dia conhecido como “Dia do Conhecimento” e que corresponde ao dia de abertura do ano lectivo na Federação Russa – o Presidente Vladimir Putin falou sobre ciência com jovens estudantes numa sessão aberta, tendo-lhes dito que “o futuro está na inteligência artificial”, e acrescentando “a inteligência artificial é o futuro, não apenas para a Rússia, mas para a humanidade. Traz oportunidades colossais, mas também ameaças que são difíceis de prever. Quem se tornar líder nesta área dominará o mundo”. Esta afirmação audaciosa foi suavizada quando acrescentou que não gostaria de ver alguém a “monopolizar” a área e que “se (a Rússia) se tornar líder nesta área, partilhará os seus conhecimentos com todo o mundo, tal como o fazemos actualmente com as nossas tecnologias nucleares”[xxi].

Nos EUA, gigantes tecnológicos como a Google ou o Facebook estão a investir fortemente em investigação e desenvolvimento (I&D) no domínio da IA, o mesmo se passando com os militares, em particular, a agência de projectos de investigação avançados para a defesa (Defense Advanced Research Projects Agency, DARPA), a que alguns chamam o “cérebro do Pentágono”.

Num artigo notável publicado na National Geographic Magazine, o autor D.T. Max sublinha que “como qualquer outra espécie, somos o produto de milhões de anos de adaptação”. “Agora ― acescenta ― estamos a tomar o destino nas nossas próprias mãos”[xxii].

Um desenvolvimento muito sensível que está a ser perseguido é a possibilidade de comandar o comportamento, e mesmo de alterar a personalidade de um ser humano, mediante um implante cerebral de pequenos circuitos electrónicos conhecidos como “chips”. Mais uma vez, a tecnologia que sustenta tal desenvolvimento pode ser uma espada de dois gumes. Por um lado, permitindo a uma pessoa recuperar faculdades físicas ou mentais perdidas ou inexistentes, incluindo defeitos de nascença (mover um membro paralizado, recuperar a visão ou audição, tratar a perda de memória ou outros sintomas relacionados com a doença de Alzheimer). Por outro lado, promovendo desenvolvimentos sensoriais e cognitivos sobrehumanos, no sentido em que conferem ao ser humano “modificado” capacidades que um ser humano comum não possui. Alguns peritos sublinham, entre essas novas capacidades, a extensão da percepção de imagens às bandas da radiação infravermelha e ultravioleta. Mas também a capacidade de memorizar do cérebro e de comunicar com outros através da transmissão telepática de pensamentos. Um implante cerebral também permitiria o acesso em segurança e permanente a informação onde e quando ela for necessária.

Segundo a fonte atrás citada, “é dinheiro do Departamento de Defesa, através do seu ramo de investigação militar, a Defense Advanced Research Projects Agency (DARPA), que financia muitos desses desenvolvimentos” nos EUA.

Um exemplo da tendência referida por D.T. Max é um laboratório no Centro de Engenharia Neuronal da Universidade da Carolina do Sul que está a testar a implantação de chips no cérebro para recuperar memórias perdidas. O autor também indica que “no ano passado, na Universidade de Pittsburgh, um indivíduo foi capaz de transmitir impulsos eléctricos do seu cérebro, através de um computador, para controlar um braço robótico e mesmo sentir aquilo que os seus dedos tocavam”. Estas realizações são promissoras para a cura ou alívio do sofrimento humano. Contudo, devemos estar conscientes dos riscos envolvidos nas aplicações que implicam interacções computador-cérebro. Como assinala D.T. Max, a ideia de que “ligando o cérebro humano a uma máquina se pode produzir um combatente sem rival não escapou à DARPA”.

Citando Annie Jacobsen[xxiii], o autor acrescenta que “Tudo o que lá é produzido tem uma dupla finalidade (…) não devemos esquecer que a missão da DARPA não é ajudar pessoas. É criar os diversificados sistemas de armas do futuro.”

In 1998, Ellen M. McGee e G. Q. Maguire, Jr., apresentaram à 20ª Conferência Mundial de Filosofia um importante ensaio, uma “Avaliação Ética dos Chips Implantáveis no Cérebro (Ethical Assessment of Implantable Brain Chips)”[xxiv].

Os autores consideram que (citação): “A implicação mais assustadora desta tecnologia é a possibilidade séria dela poder facilitar o controlo totalitário dos seres humanos”.

Eles questionam, em particular, as consequência de um eventual transplante do chip cerebral de um cérebro humano para o cérebro doutra pessoa. Será “possível capturar os dados que representam a totalidade das experiênciais sensoriais de um ser humano num único chip implantado no cérebro?”. Na eventualidade de um chip de memórias ser transplantado dum cérebro para outro, a continuidade psicológica associada à identidade pessoal dos seres humanos envolvidos seria perturbada, com inegáveis ramificações. “Teria a pessoa transplantada as identidades de outras pessoas?” ― interrogam-se os autores.

Estas são questões muito sérias relacionadas com a aplicação de princípios éticos e normas morais. Exigem um diálogo e debate social informados e inclusivos. Os trabalhadores científicos são chamados a desempenhar o papel único que podem ter em tal debate.

Dito isto, é importante sublinhar que em todos os estados tecnologicamente avançados, o contributo dos trabalhadores científicos foi e continua a ser de importância primordial para o progresso das actividades de I&D orientadas directa ou indirectamente para aplicações militares. Pode-se dizer que a Ciência e Tecnologia estão, em grande medida “militarizadas” ou que um número considerável de cientistas e técnicos são “refém” nas mãos dos militares.

Stuart Parkinson, da organização britânica independente, sem fins lucrativos “Scientists for Global Responsibility” e os seus colegas, discutiram amplamente o assunto da militarização da ciência. “Soldiers in the Laboratory” (Soldados no Laboratório) é uma das suas publicações mais notáveis[xxv]. O título reflecte a tendência crescente no complexo militar-industrial para subcontratar grupos universitários, especialmente no sector privado, no Reino Unido. O mesmo se passa noutros países.

Os autores assinalam que o esforço para integrar crescentemente a I&D militar nas universidades está a acontecer rapidamente, apesar da ausência de uma discussão sobre o assunto no seio das comunidades científica e tecnológica. Esta tendência não apenas compromete a liberdade académica mas, na prática, desvia financiamentos de aplicações civis.

À medida que as universidades são compelidas a desenvolver laços mais estreitos com os militares e a actuar de forma mais comercial, dedicando mais recursos a projectos com objectivos financeiros, as vozes discordantes dentro da comunidade científica vão sendo marginalizadas, o pessoal académico sente-se vulnerável e os críticos independentes tornam-se escassos.

ROBÔS-ASSASSINOS: QUESTÕES MORAIS, ÉTICAS E JURÍDICAS

A questão da responsabilidade dos sistemas autónomos, em particular das armas autónomas letais, é um assunto que deve preocupar não apenas os trabalhadores ceintíficos e especialistas, mas o público em geral.

O fabricante russo de armas Kalashnikov desenvolveu um módulo de combate totalmente automatizado baseado em redes neuronais artificiais, que permite identificar alvos, aprender e tomar decisões por conta própria.

© Kalashnikov Group

Tucker Davey aborda esta questão num artigo intitulado “Who is Responsible for Autonomous Weapons?[xxvi]

No caso de um veículo autónomo, embora possam ocorrer acidentes fatais, o fabricante deve adoptar todas as soluções tecnológicas possíveis para os evitar. Mesmo neste casos, a questão da determinação da responsabilidade pode levantar problemas complexos num quadro jurídico específico. Quando se tem de lidar com armas autónomas, aquilo que orienta o fabricante é potenciar a letalidade do seu equipamento.

Os robôs militares autónomos ― sublinha o autor ― “podem deslocar-se por si próprios em diferentes ambientes e tomar autonomamente decisões acerca de quem deve ser morto e quem deve ser poupado.” Este facto suscita “questões importantes que devem ser consideradas conjuntamente por governos e investigadores (…)”, nomeadamente: “Como é que responsabilizamos seres humanos pelas acções de sistemas autónomos? E como é que se faz justiça quando o assassino é, basicamente, um computador?“. Davey acrescenta que “Não existem respostas simples para este dilema”.

ELIMINAR OS SERES HUMANOS DO CAMPO DE BATALHA[xxvii]

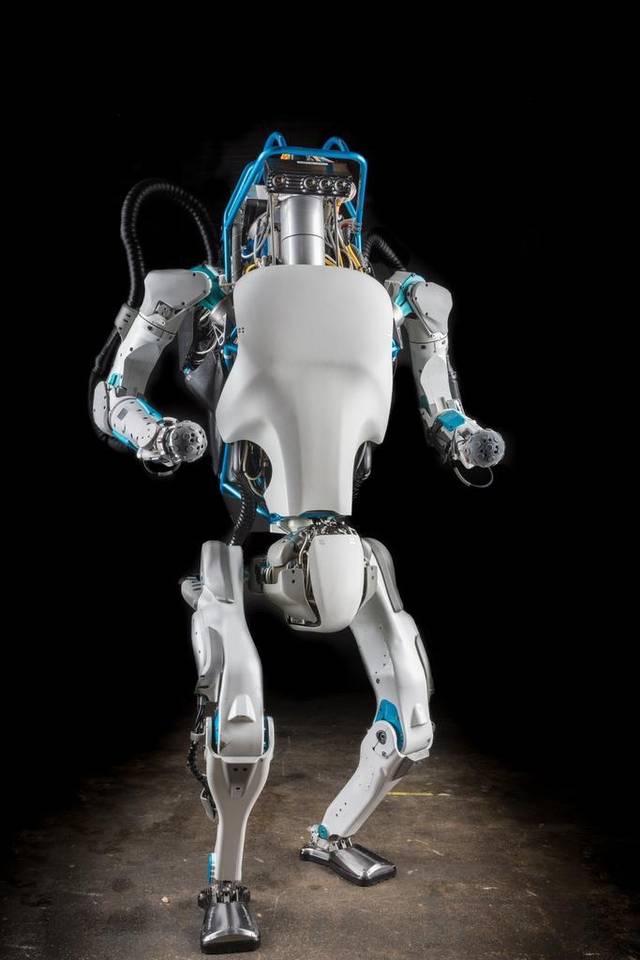

Do ponto de vista dos eventuais beligerantes, a substituição de soldados humanos por robôs humanóides apresenta vantagens significativas. Por um lado, as capacidades dos combatentes robóticos humanóides poderão ser superiores às dos soldados humanos; por outro lado, os responsáveis políticos evitarão o espectáculo dos sacos transportando cadáveres de regresso a casa e os funerais na presença de familiares e amigos enlutados.

O projeto e produção do Atlas, um avançado robô humanóide, foram supervisionados pela DARPA, uma agência do Departamento de Defesa dos Estados Unidos, em cooperação com a Boston Dynamics. File licensed under Creative Commons Attribution-Share Alike 4.0 International

Tal como no caso anteriormente referido do desenvolvimento de ogivas nucleares miniaturizadas, deve-se notar que a possibilidade de colocar no campo de batalha soldados-robôs poderá baixar o limiar para a eclosão de uma guerra.

Quando se fala de armas autónomas letais deve-se referir que, além das armas robóticas “ligeiras”, incluindo robôs humanóides, as principais potências militares estão também a investir em módulos de combate de maior envergadura, com capacidade de auto-decisão.

O fabricante russo de armas Kalashnikov anunciou recentemente o desenvolvimento de um módulo de combate totalmente autónomo baseado em redes neuronais artificiais. Segundo um comunicado de imprensa: “As tecnologias de redes neuronais permitem ao módulo identificar alvos e tomar decisões por si próprio”. “Não é claro se o módulo abrirá fogo por sua própria iniciativa ou se aguardará uma autorização humana” ― acrescenta”[xxviii].

Para concluir esta reflexão sobre as ameaças associadas às aplicações militares da Inteligência Artificial, é apropriado citar o seguinte excerto da Carta Aberta de 2015, já referida, e que foi co-assinada por investigadores de IA e Robótica:

“A questão-chave para a humanidade no presente é saber se deve iniciar uma corrida global aos armamentos que usam IA ou se se deve evitá-la. Se uma qualquer grande potência militar avançar com o desenvolvimento de armas baseadas em IA, uma corrida global aos armamentos é virtualmente inevitável, e o desfecho dessa trajectória tecnológica é óbvio: as armas autónomas tornar-se-ão as Kalashnikovs de amanhã. Ao contrário das armas nucleares, não exigem matérias-primas dispendiosas ou difíceis de obter e, por isso, serão omnipresentes e baratas para produção em massa por qualquer potência militar de dimensão significativa”[xxix].

Frederico Carvalho

03 de Dezembro de 2017

O presente artigo foi apresentado na 22ª Assembleia Geral da Federação Mundial dos Trabalhadores Científicos, Grupo de Trabalho 1 (Desarmamento Internacional e Cooperação), reunida em Dacar, Senegal, de 4 a 8 de Dezembro de 2017.

[i]“The Military Balance 2016”,IISS-The International Institute for Strategic Studies, Press Release, 9 February 2016. Ver relatório de 2017 emhttps://www.iiss.org/en/publications/military%20balance/issues/the-military-balance-2017-b47b

[ii]Paul Craig Roberts, “One Day Tomorrow Won’t Arrive”, 28 Outubro 2017,(https://www.paulcraigroberts.org/2017/10/28/one-day-tomorrow-wont-arrive/)

[iii]A decisão de alterar a posição dos ponteiros do relógio cabe ao Bulletin of Atomic Scientists’ Science and Security Board que inclui “um grupo seleccionado de líderes globalmente reconhecidos com um interesse especial pelos riscos nucleares, alterações climáticas e tecnologias emergentes”.

[iv]Corresponde a cerca de 1,7 vezes 1012 US Dollars.

[v]“World military spending: Increases in the USA and Europe, decreases in oil-exporting countries”, The Stockholm International Peace Research Institute, 24 de Abril de 2017

[vi]Kimberly Amadeo, “U.S. Military Budget: Components, Challenges, Growth”, The Balance, actualizado em 10 Agosto 2017 (https://www.thebalance.com/u-s-military-budget-components-challenges-growth-3306320 )

[vii]Thomas Hedges, “The Pentagon has never been audited. That’s astonishing”, The Guardian, 20 Março 2017 ( https://www.theguardian.com/commentisfree/2017/mar/20/pentagon-never-audited-astonishing-military-spending )

[viii]Durante a Segunda Guerra Mundial, o poder explosivo total das bombas detonadas foi equivalente a 3 MT de TNT, um valor que corresponde ao poder explosivo total de 10 armas nucleares estratégicas de dimensão média.

[ix]Kristensen,H. M., andR. S.Norris.2013. “Global Nuclear Weapons Inventories, 1945-2013.”Bulletin of the Atomic Scientists”, 69, 75–81.

[x]O ARTIGO VI do Tratado determina: “Cada uma das Partes no Tratado compromete-se a efectuar negociações de boa fé sobre medidas eficazes à cessação da corrida aos armamentos nucleares numa data próxima e ao desarmamento nuclear, e sobre um tratado de desarmamento geral e completo sob um controlo internacional estrito e eficaz.”

[xi]“Obama Prague Speech On Nuclear Weapons: FULL TEXT”, Huffington Post, 05/06/2009 05:12 am ET, actualizado em 5 Maio 2011 (https://www.huffingtonpost.com/2009/04/05/obama-prague-speech-on-nu_n_183219.html)

[xii]“The Trillion (and a Half) Dollar Triad?”Arms Control Association, Issue Brief, Volume 9,Issue 6, August 18, 2017 . A Arms Control Association é uma organização não-partidária sedeada nos Estados Unidos e fundada em 1971 (https://www.armscontrol.org/issue-briefs/2017-08/trillion-half-dollar-triad).

[xiii]Cf. nota 12.

[xiv]“How US nuclear force modernization is undermining strategic stability: The burst-height compensating super-fuze”, Hans M. Kristensen, Matthew McKinzie, Theodore A. Postol, The Bulletin of Atomic Scientists-ANALYSIS, 1 de Março de 2017 (https://thebulletin.org/how-us-nuclear-force-modernization-undermining-strategic-stability-burst-height-compensating-super10578 ). Podem ser encontradas nesta referência informações técnicas acerca da “super-fuze”.

[xv]Cf. https://en.wikipedia.org/wiki/Convention_on_Certain_Conventional_Weapons

[xvi]Não existe informação acerca das Actas desta reunião..

[xvii]“The Future of Life Institute” é uma organização de voluntários na região de Boston dedicada à investigação e divulgação. A organização trabalha para mitigar os riscos existenciais que ameaçam a humanidade, em particular o risco colocado pela inteligência artificial de ponta (Wikipedia). Trata-se de uma organização sem fins lucrativos fundada em Março de 2014, localizada em Cambridge, Massachusetts, USA.

[xviii]24thInternational Joint Conference on Artificial Intelligence, Buenos Aires, July 2015

[xix]“Autonomous Weapons: An Open Letter From AI &Robotics Researchers”, July 2015,(https://futureoflife.org/open-letter-autonomous-weapons/)

[xx]Cf. https://www.britannica.com/technology/artificial-intelligence

[xxi]“Whoever leads in AI will rule the world’: Putin to Russian children on Knowledge Day”, 01 de Setembro de 2017(https://www.rt.com/news/401731-ai-rule-world-putin/)

[xxii]D.T. Max, “How Humans Are Shaping Our Own Evolution”, National Geographic, Abril 2017

[xxiii]Annie Jacobsen é uma jornalista de investigação americana, autora e finalista do Prémio Pulitzer de 2016 na categoria de história. É autora do livro “The Pentagon’s Brain: An Uncensored History of DARPA, America’s Top-Secret Military Research Agency”, publicado em 22 September 2015 por Little, Brown and Company

[xxiv]Ver “The Proceedings of the Twentieth World Congress of Philosophy”, Boston, Massachusetts, 10 -16 de Agosto de 1998

[xxv]Chris Langley, “Soldiers in the Laboratory ― Military involvement in science and technology – and some alternatives” Editors : Stuart Parkinson and Philip Webber, Janeiro de 2005

Chris Langley, Stuart Parkinson, Philip Webber,“More Soldiers in the Laboratory. The militarisation of science and technology – an update”, Agosto de 2007(http://www.sgr.org.uk/publications/more-soldiers-laboratory)

[xxvi]Tucker Davey, “Who is Responsible for Autonomous Weapons?”, 21 de Novembro de 2016 (https://futureoflife.org/2016/11/21/peter-asaro-autonomous-weapons/)

[xxvii]Alguns analistas consideram também o impacto sobre o mercado de trabalho da utilização extensiva de robôs controlados por algoritmos de IA, numa tendência que pode ser descrita como “a eliminação dos trabalhadores humanos” da economia.

[xxviii]https://www.rt.com/news/395375-kalashnikov-automated-neural-network-gun/ (5 de Julho de 2017)

[xxix] Cf. Nota 18